2021. 12. 22. 15:07ㆍ캐리의 데이터 세상/캐리의 데이터 공부 기록

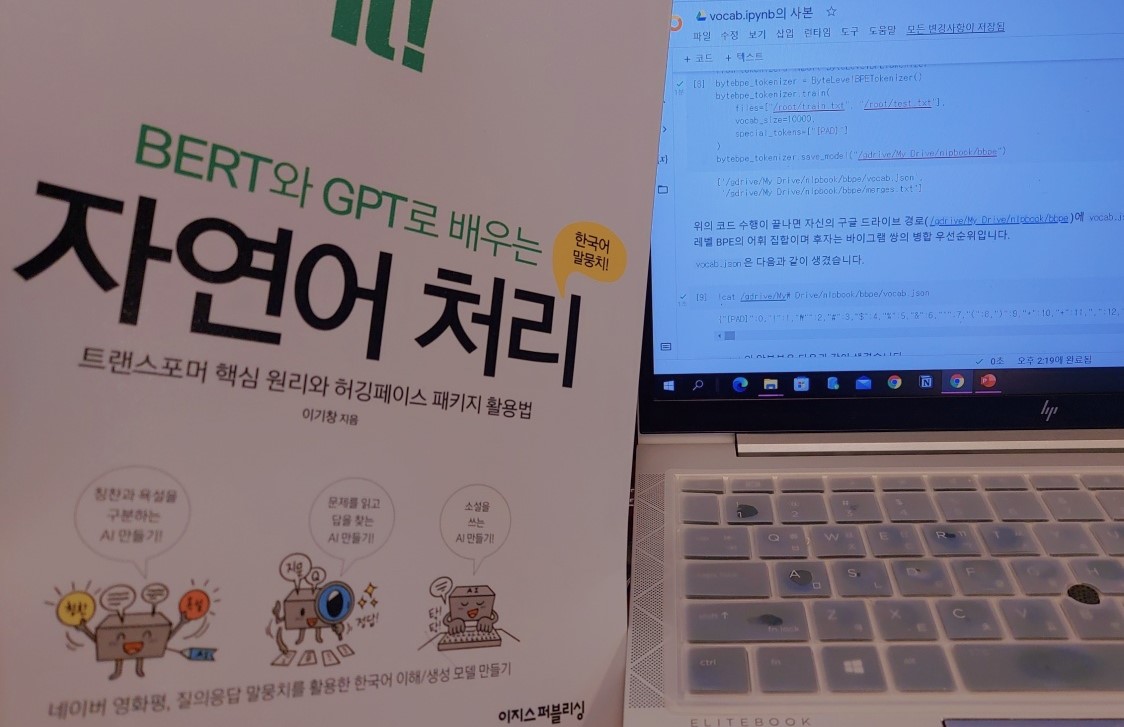

12월에 출간된 따끈따끈한 Do it 시리즈 신간 <Bert와 GPT로 배우는 자연어 처리>를 내 돈 내산 직접 구입해서 따라 해 보면서 챕터별로 저자가 소개해 둔 자료들 링크와 함께 정리해봅니다. 오렐리 nlp 시리즈 책들도 가지고 있지만 손을 못 대고 있던 와중에 한국어 말뭉치로 흐름을 따라잡기 쉽게 설명된 얇은 책이라 실행 코드를 코랩으로 모두 돌려볼 수 있도록 QR 코드로 잘 안내되어 있으니 입문용으로 괜찮아 보입니다.

자연어 처리 관련 참고자료 모음

책에 수록된 코드 실습에는 파이토치 지식이 없어도 무방하다고는 하나 알고 있으면 더 수월, 파이토치 자료를 아래와 같이 소개해둠.

토큰화 관련 학습 자료

허깅페이스 토크나이저는 바이트 페어 인코딩, 워드피스 등 각종 서브워드 토큰화 기법은 물론 유니코드 정규화, 프리토크나이즈, 토큰화 후처리 등 다양한 기능을 제공함

▶ 논문 1 : Netural Machine Translation of Rare Words with Subword Units

- 바이트 페어 인코딩을 자연어 처리에 처음 도입해 본 논문

▶ 논문 2 : Japanese and Korean Voice Search

- 워드피스 기법을 제안한 논문

트랜스포머 관련 논문

구글 연구팀이 2017년 발표, Pre-train 없이 모델을 처음부터 학습했는데도 당시 최고 성능을 기록해 주목받았던 연구. 이후 BERT, GPT 등 요즘 널리 쓰이는 모델 아키텍처가 전부 트랜스포머임.

논문 1 : Attention is All You Need

트랜스포머의 모델 구조를 파이토치 코드로 해설한 블로그

트랜스포머 계산 과정을 그림, 애니메이션, 동영상으로 시각화한 글. 내부 동작 원리를 직관적으로 이해해 볼 수 있음

글 : The Illustrated Transformer

계속 업데이트...

'캐리의 데이터 세상 > 캐리의 데이터 공부 기록' 카테고리의 다른 글

| 직장인 수학 공부 - ebs 교재 활용 (0) | 2023.06.28 |

|---|---|

| 코세라 ML 강의 듣기 (0) | 2022.07.31 |

| Udemy 강의 할인받기 (2) | 2022.02.08 |

| AI 클론 프로젝트 (0) | 2021.11.01 |

| AWS 클라우드 실습 기록 - 서버생성 및 글로벌 인프라 (0) | 2021.09.07 |

| 무료로 인공지능 교육과정 이어가기 (0) | 2021.09.03 |

| 구글 코랩 마크다운(Markdown) 텍스트 편집 (1) | 2021.07.31 |